Apple no podia esperar. Tot i que té previst la seva inauguració de la WWDC Keynote per a principis de juny, el camp de la IA avança cada dia, i probablement és per això que no volia perdre més temps. En forma de nota de premsa, va exposar què podrà fer la seva intel·ligència artificial a iOS 17 i li va afegir altres funcions que giren al voltant de l'accessibilitat. N'hi ha molt, les funcions són interessants, però hi ha un signe d'interrogació sobre la usabilitat massiva.

Podria ser t'interessa

L'anunci de la notícia també va comptar amb el suport del Dia Mundial de l'Accessibilitat, que és el dijous, perquè les funcions recentment introduïdes giren al voltant de l'accessibilitat dels iPhones de la A a la Z. L'accessibilitat és un gran bloc de funcions de l'iPhone que pretén ajudar a controlar-lo a tot arreu. diferents formes de discapacitat, encara que moltes d'elles és clar, tothom les pot utilitzar, la qual cosa també s'aplica a les novetats que veurem a iOS 17. No obstant això, no totes, com Assistive Access, estan 100% basades en IA.

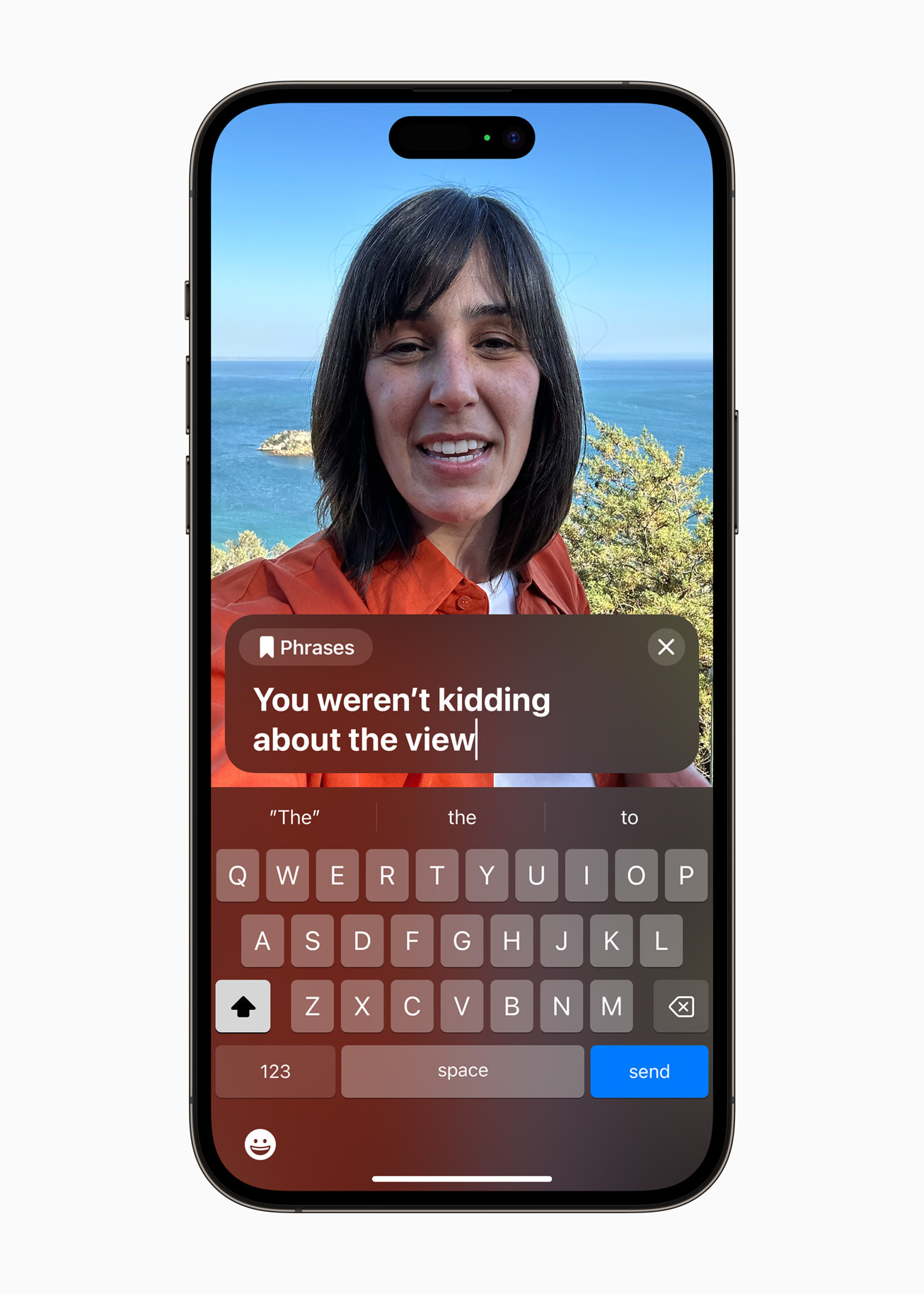

Discurs en viu

El que escriviu a la pantalla de l'iPhone es llegirà a l'altre costat. Hauria de funcionar localment, tot i que també hauria de funcionar amb una trucada telefònica. La funció podrà funcionar en temps real, però al mateix temps oferirà frases preestablertes per fer que la comunicació no només sigui la més fàcil, sinó també la més ràpida, quan no caldrà anotar les connexions d'ús freqüent. Hi ha una gran qüestió de disponibilitat, és a dir, si això també funcionarà en llengua txeca. Esperem que sí, però no ens ho creiem massa. La qual cosa, al cap i a la fi, també s'aplica a altres notícies.

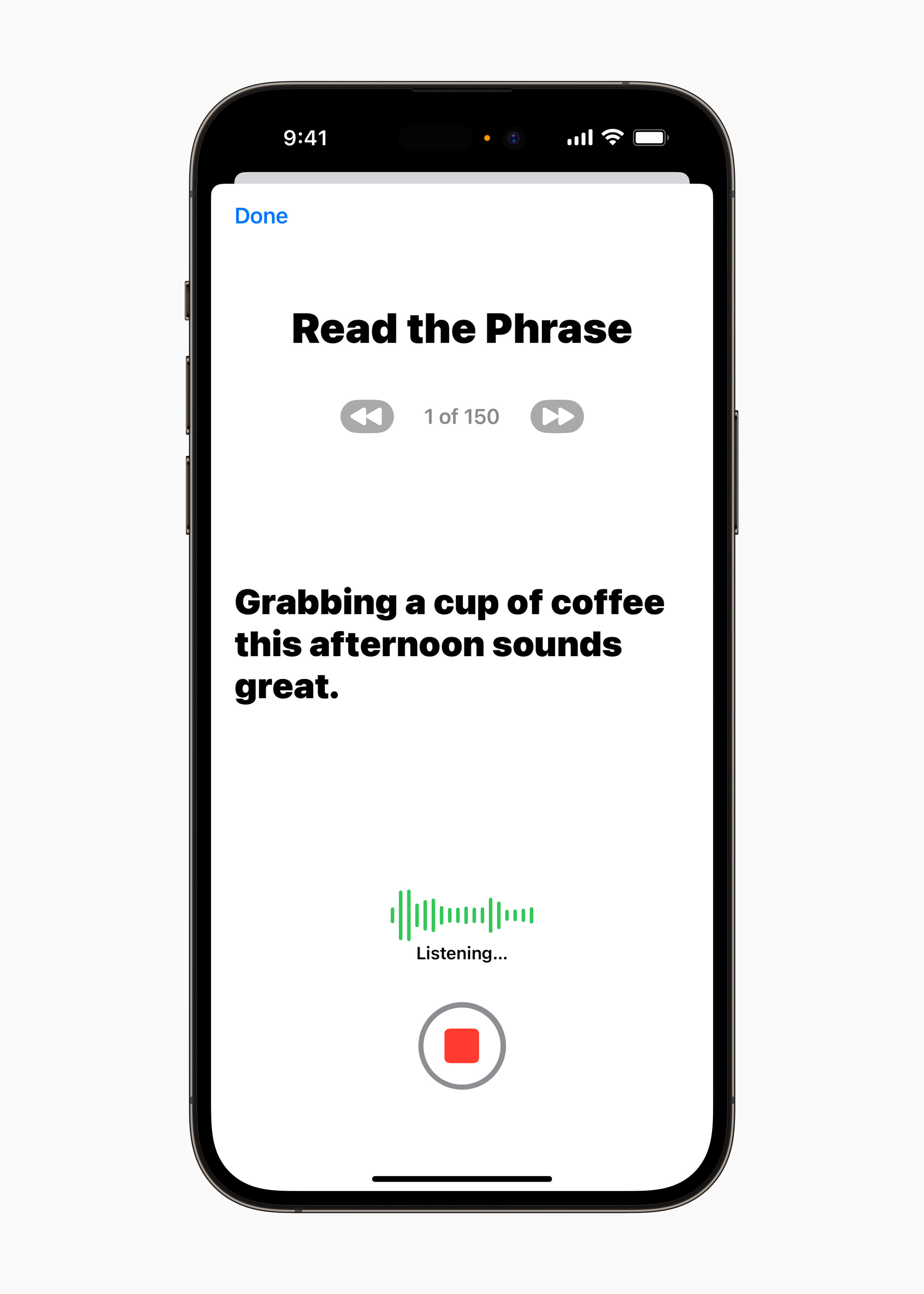

Veu personal

Després de la innovació anterior, també hi ha una funció associada a la veu i la parla, que, cal dir-ho, encara no té cap paral·lelisme. Amb la funció Personal Voice, els iPhones podran crear una còpia exacta de la teva pròpia veu, que podràs utilitzar en el cas del punt anterior. El text no serà llegit per una veu unificada, sinó per la vostra. Amb l'excepció de les trucades telefòniques, això, per descomptat, també es pot utilitzar en missatges d'àudio d'iMessage, etc. La creació sencera de la vostra veu no durarà més de 15 minuts per IA i aprenentatge automàtic, durant els quals llegireu el text presentat i altres textos. indicacions. Aleshores, si per algun motiu perds la veu, es desarà al teu iPhone i encara podràs parlar amb ella. No hauria de ser un risc de seguretat, perquè tot passa a nivell local.

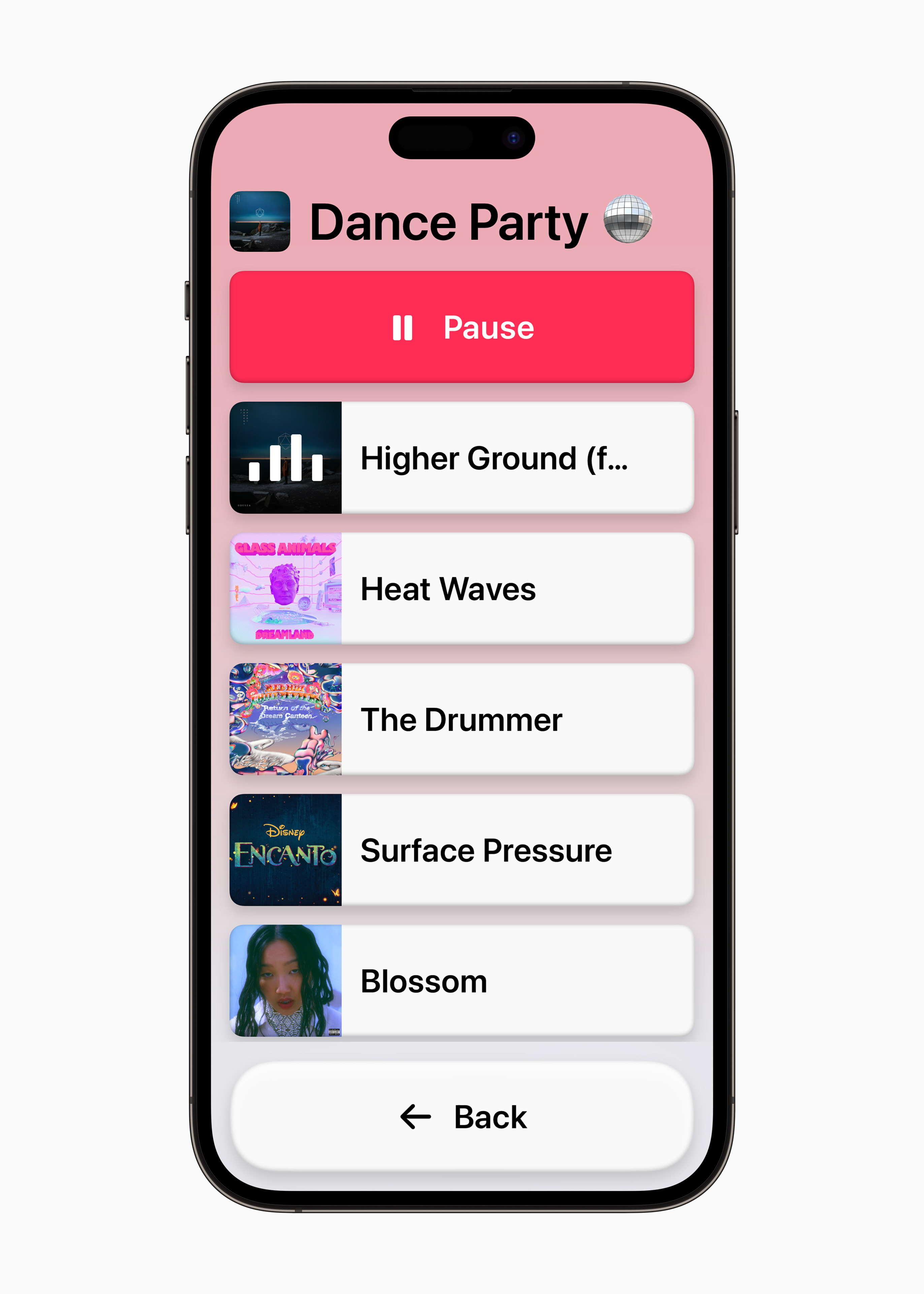

Enfocament d'assistència

Al món dels dispositius Android, el mode sènior és una cosa força habitual. A més, també és molt fàcil d'utilitzar, al cap i a la fi, igual que la que ajusta la interfície per als més petits. En el cas dels iPhone, el primer esmentat s'ha especulat durant molt de temps, però ara per fi Apple ho ha revelat. En activar-lo, es simplificarà globalment l'entorn, quan, per exemple, s'unificaran aplicacions com Phone i FaceTime, les icones seran més grans i també hi haurà personalitzacions, gràcies a les quals la interfície s'establirà exactament segons les necessitats de l'usuari (podeu posar una llista en lloc d'una graella, etc.).

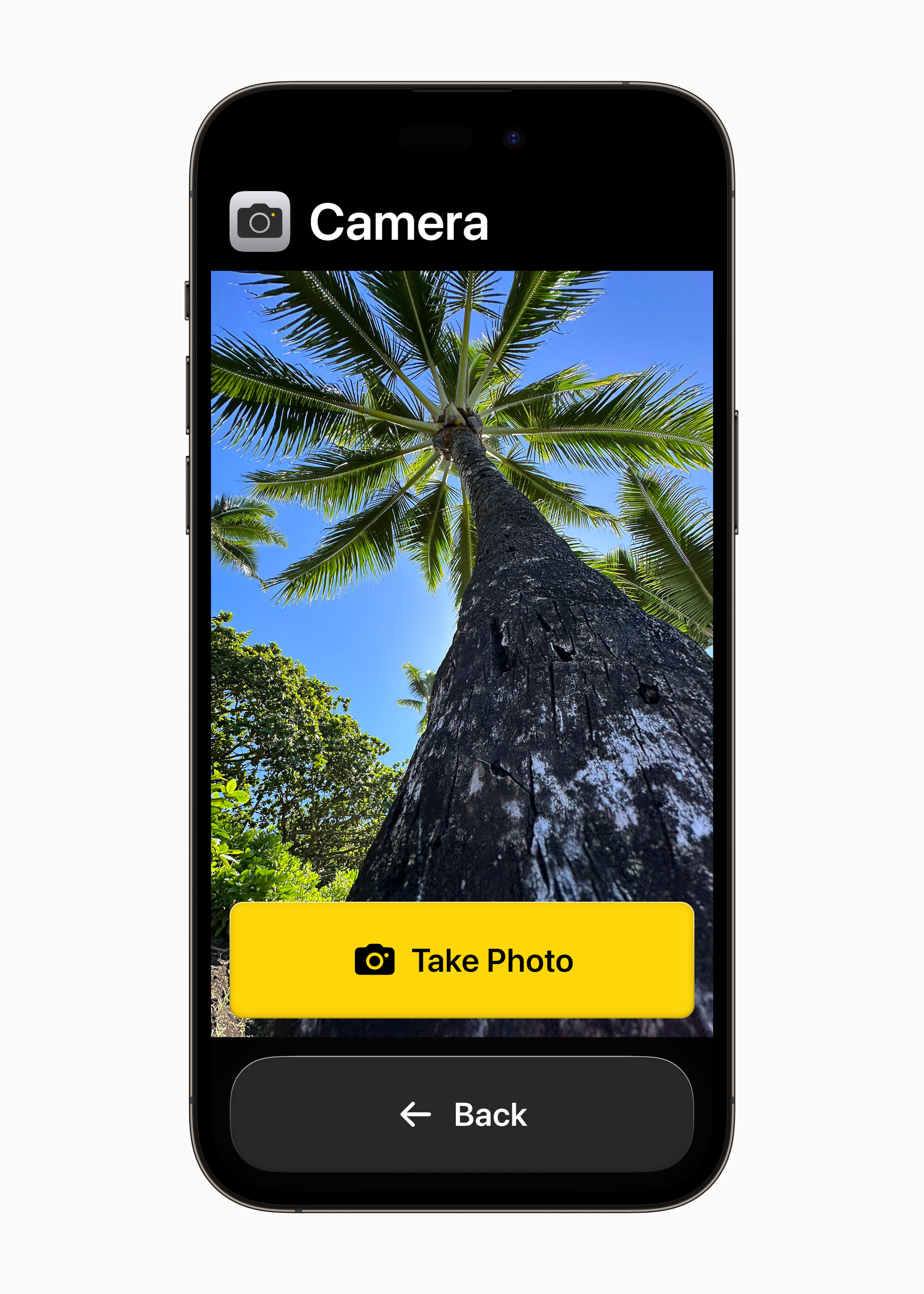

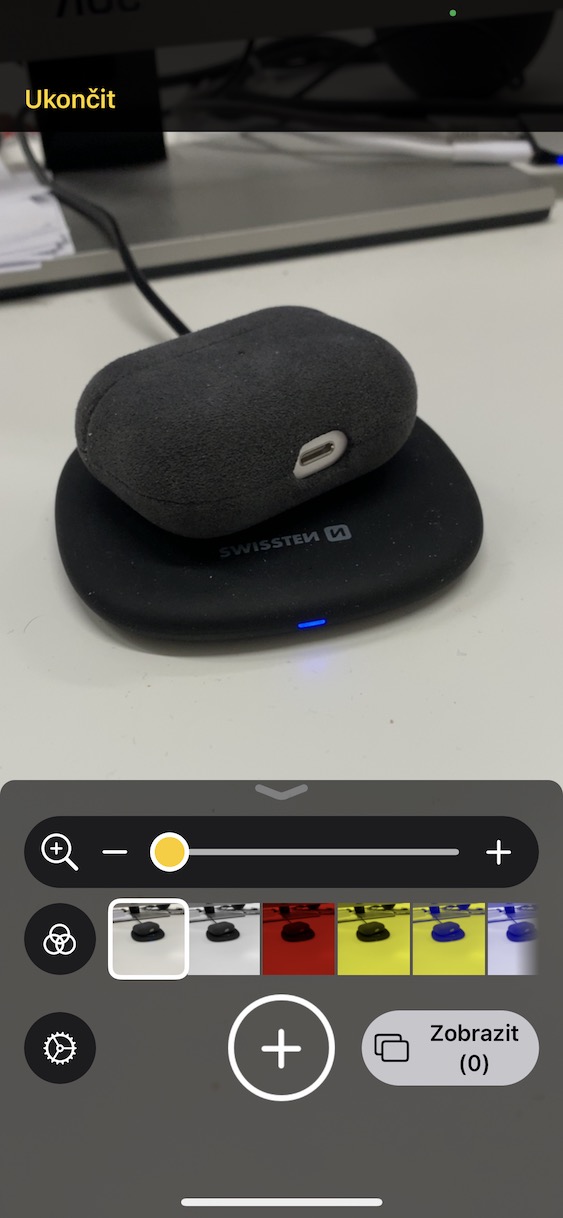

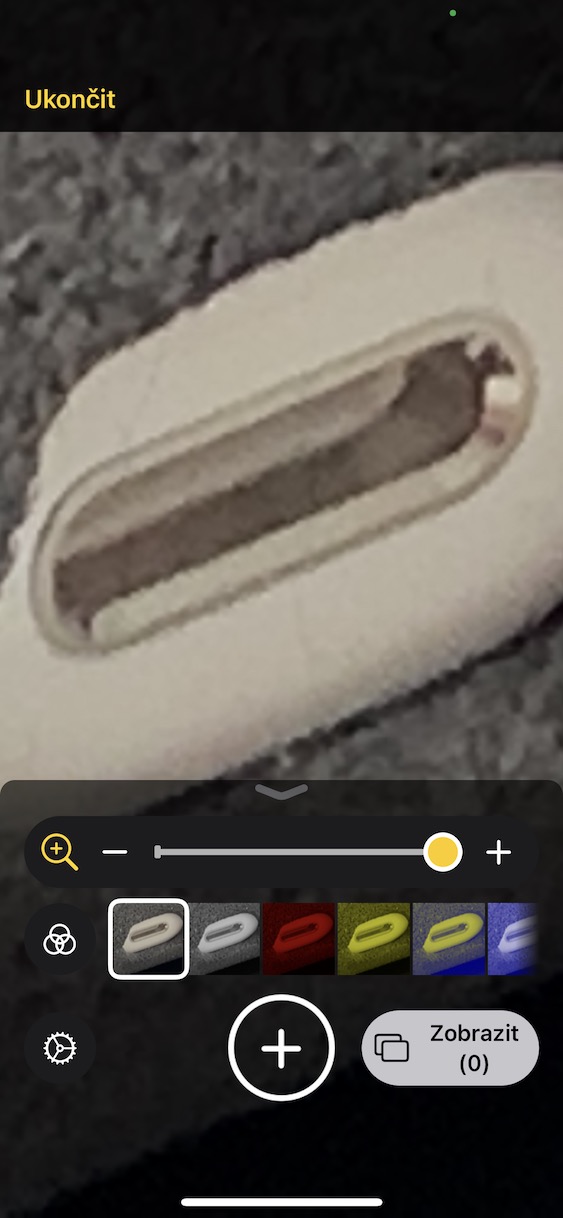

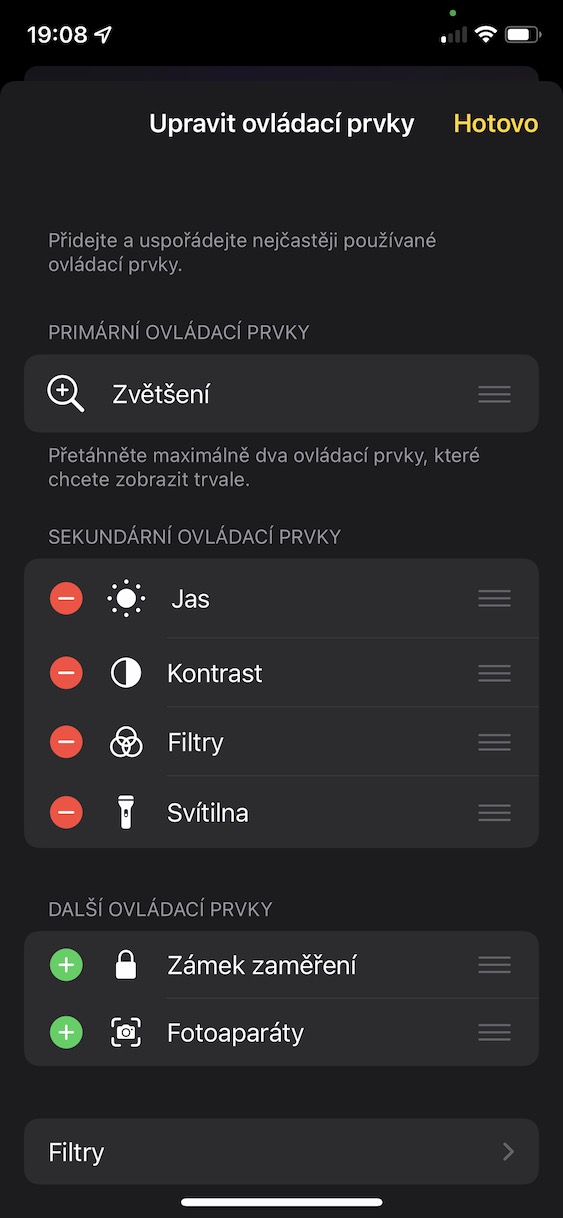

Mode de detecció de funcions de lupa

Si algú pateix una discapacitat visual, Apple intentarà facilitar-li la vida utilitzant la funció de lupa, que utilitza l'aprenentatge automàtic i la intel·ligència artificial per intentar reconèixer el que l'usuari del telèfon apunta a través del visor de la càmera. Aleshores, la funció hauria de reconèixer-la correctament i dir-ho a l'usuari per veu. Al cap i a la fi, a l'App Store hi ha un munt d'aplicacions sobre aquest tema, són bastant populars i realment funcionals, així que està clar d'on es va inspirar Apple. Però Apple ho porta encara més enllà en el cas de l'apunt directe, és a dir, sí, amb el dit. Això és útil, per exemple, amb diversos botons dels electrodomèstics, quan l'usuari sabrà clarament quin dit té i si l'ha de prémer. No obstant això, la lupa també hauria de ser capaç de reconèixer persones, animals i moltes altres coses, que, al cap i a la fi, també pot fer Google Lens.

Més notícies Accessibilitat

Es va publicar una altra línia de funcions, entre les quals cal destacar dues en particular. El primer és la possibilitat de posar en pausa imatges amb elements en moviment, normalment GIF, a Missatges i Safari. Després d'això, es tracta de la velocitat de parla de Siri, que podràs limitar de 0,8 per duplicar la velocitat.

Podria ser t'interessa

Adam Kos

Adam Kos